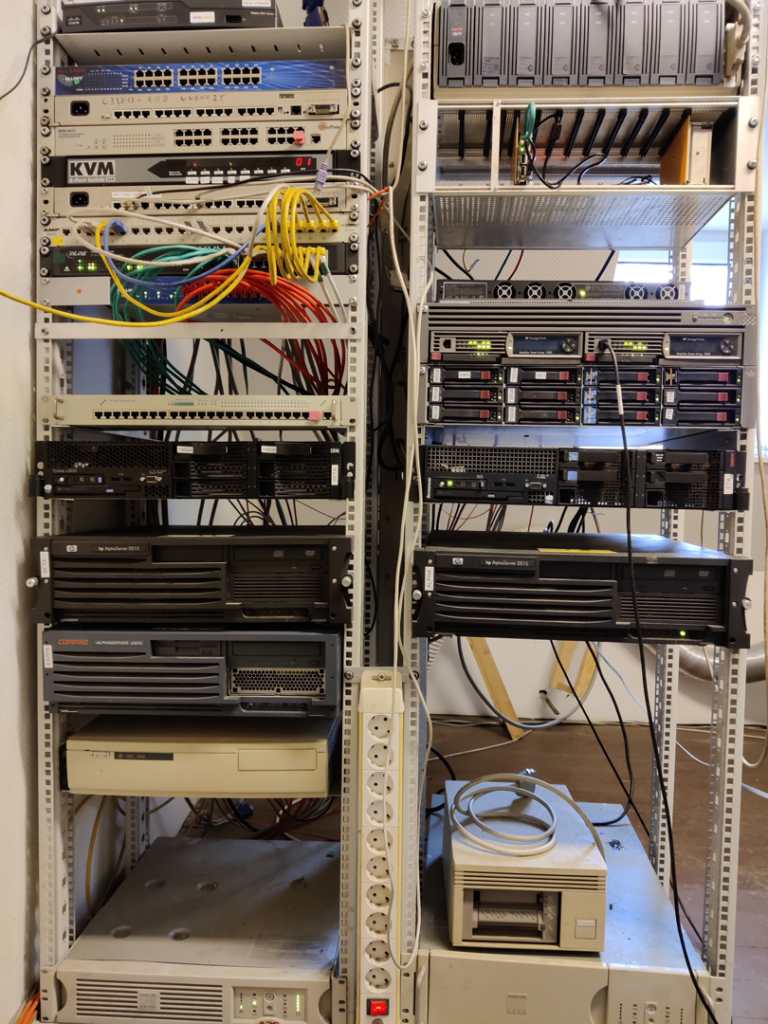

Zwei Racks voller Hardware haben seit mehr als 15 Jahren meine Serversammlung zuverlässig bereitgestellt. Das hätte auch so für einige Zeit weitergehen können, wären da nicht mehrere Faktoren, die eine komplette Überarbeitung der Umgebung sinnvoll machten:

- Für die zum Teil sehr alte Hardware wird die Ersatzteilversorgung immer schwieriger und teuerer. Ich habe in den Jahren nicht viel gebraucht, aber das Risiko einesKomplettausfall einer wichtigen Komponente, die dann erst nach langen Beschaffungszeiten erst wieder in BEtrieb genommen werden kann, steigt.

- Alle Systeme waren nicht mehr ausbahfähig und zum teil an Rande ihrer Kapazität. Neue Funktionen ließen sich nicht mehr integrieren.

- Der Stromverbrauch ist viel zu hoch. Für den Betrie waren in Jahr mehrere Tausend Euro erforderlich.

- Eine Softwarekomponenten erfordern in der aktuellen Version Hardware-Eigenschaften, die vo den alten Systemen nicht bereitgestellt werden. Eine, oft auch aus Sicherheitsgründen, erforderliche Aktualiserung ist daher unmöglich.

Ein Reihe neuer Hardwareangebote, die in den letzten Monaten auf den Markt gekommen sind, löst alle diese Probleme.

Die alten Umgebung:

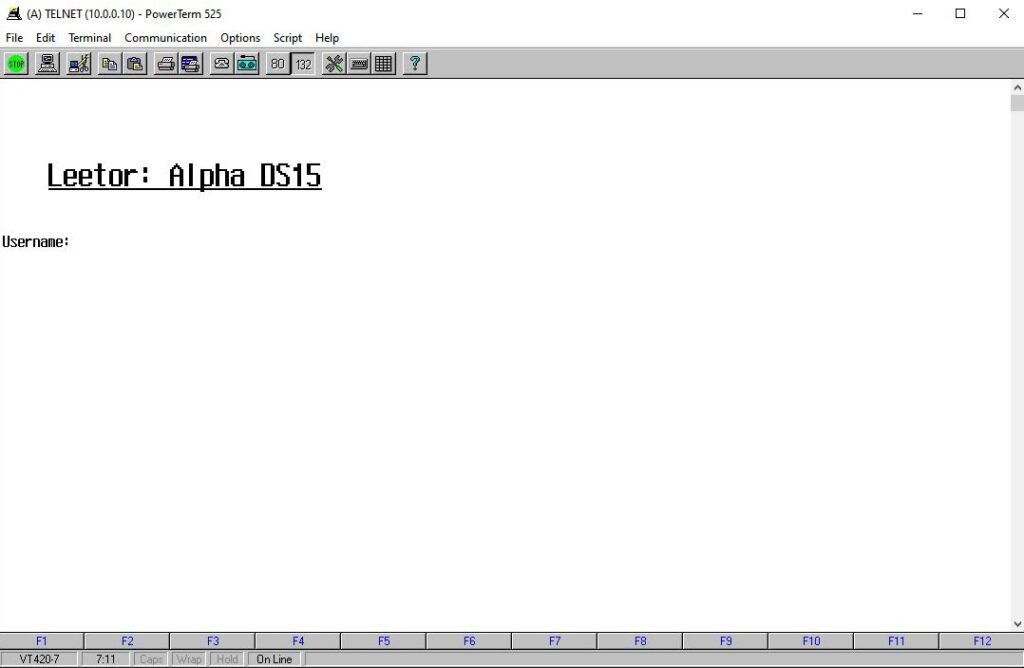

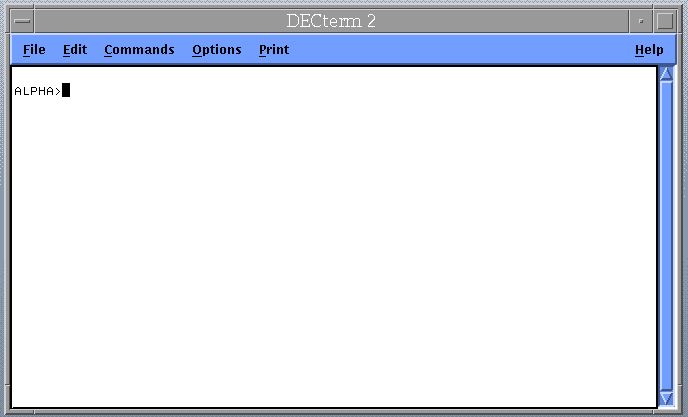

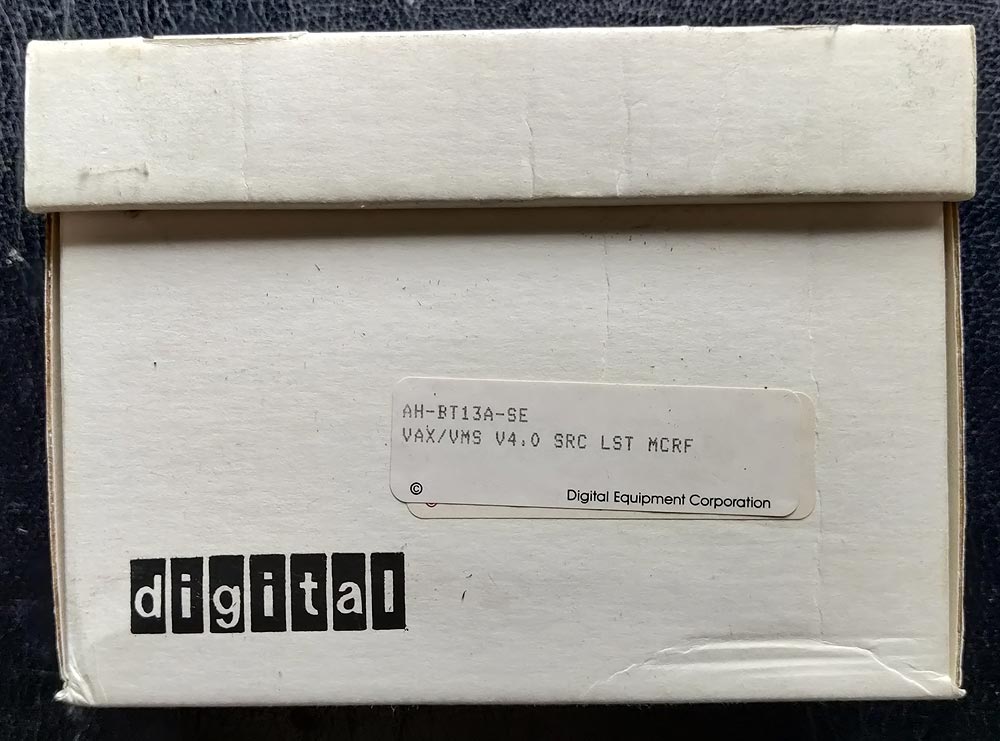

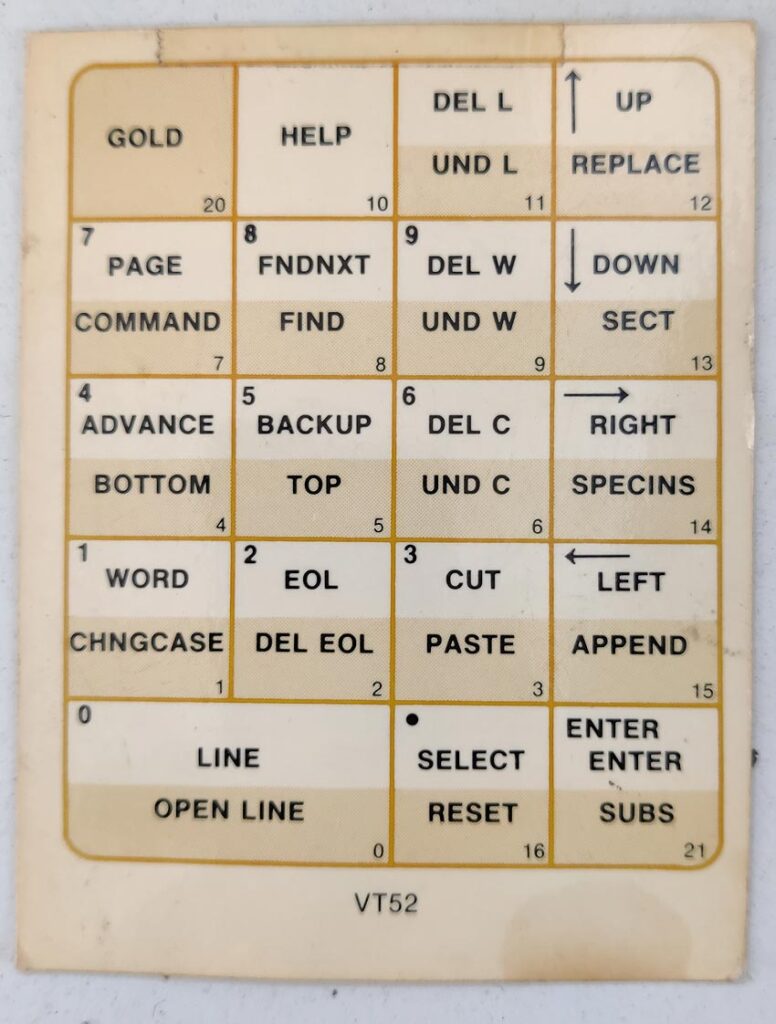

3 x DEC/ComPaq/HP Alphaserver unter OpenVMS 8.4 – OpenVMS spielt bei mir, aus nostalgischen Gründen, eine große Rolle und muss daher auch zukünftig betrieben werden können.

Komplett redundanter MSA1500 Fibre Channel SAN storage.

Die großen Nachteile dieser an sich eleganten Lösung für die Bereitstellung von redundanten Plattenplatz sind:

Es werden nur Platten bis 1TB Große und zudem keine SSDs unterstützt.

Die maximale Größe von 12TB (Sicherheitsmaßnahmen wie Spiegelung halbieren den nutzbaren Bereich) verhindern den Betrieb einer vernünftig dimensionierten Cloud.

Der Stromverbrauch ist viel zu hoch.

Die Abwärme ist viel zu hoch und erfordert im Sommer eine Klimatisierung.

Für die Anbindung an die Server ist ein eigenes Glasfasernetzwerk erforderlich, dass auf Grund seines Alters kaum schneller als 2,5GB-Kupfer-Ethernetanbindungen ist.

Die Ersatzteilsituation ist kritisch.

2 x IBM/Lenovo Server

Die Systeme sind von ESX-Version ab 6.5 nicht mehr unterstützt.

30 GB Haupspeicher pro Server reichen auch beim konsequenten Einsatz von Debian-Systeme, die ja nicht sehr speicherhungrig sind, gerade so aus. Einen Ausbau der vituellen Serverlandschaft ode die Anpassung an höheren Bedarf einzelner Dienste ist icht möglich, beide Server sind aktuell voll ausgelastet.

Auch hier ist die Ersatzteilbeschaffung ein Problem,genau wie der Strombedarf und die Abwärme.

Die Lizenzpolitik von ESX hat sich so verändert, dass eine weitere Nutzung nicht sinnvoll ist.

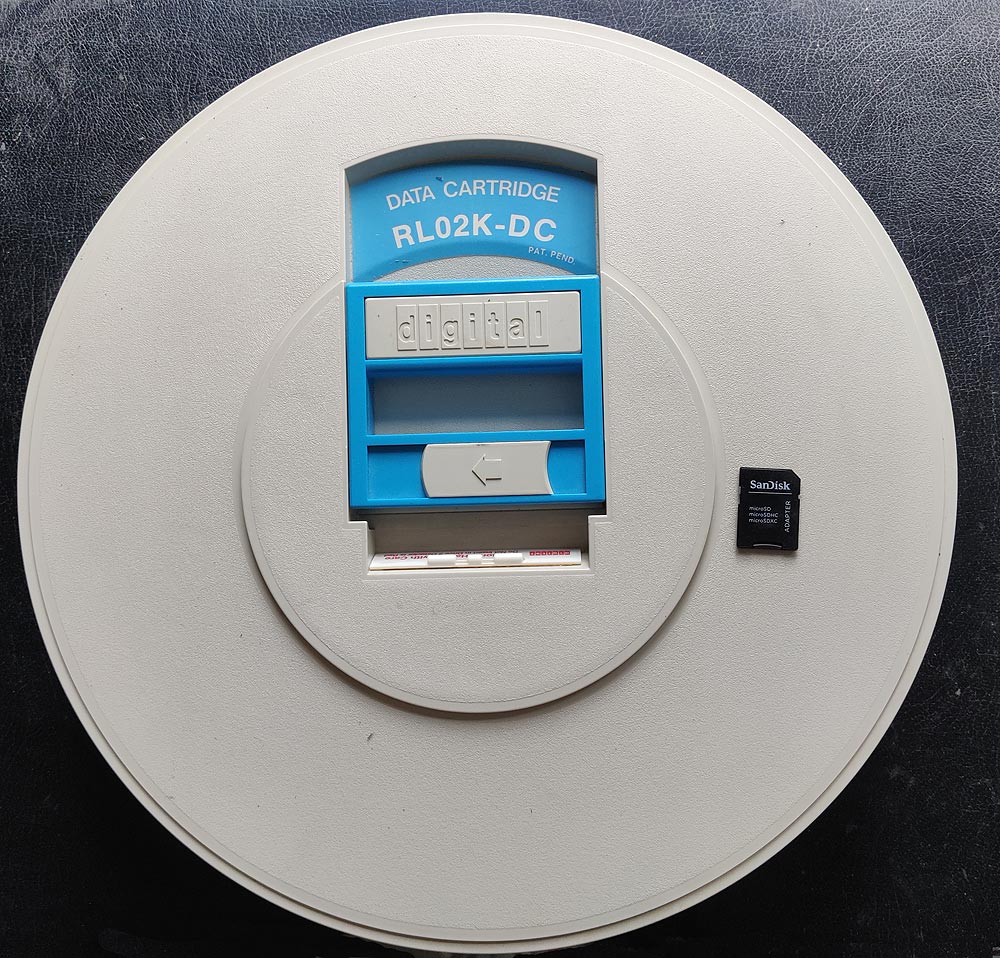

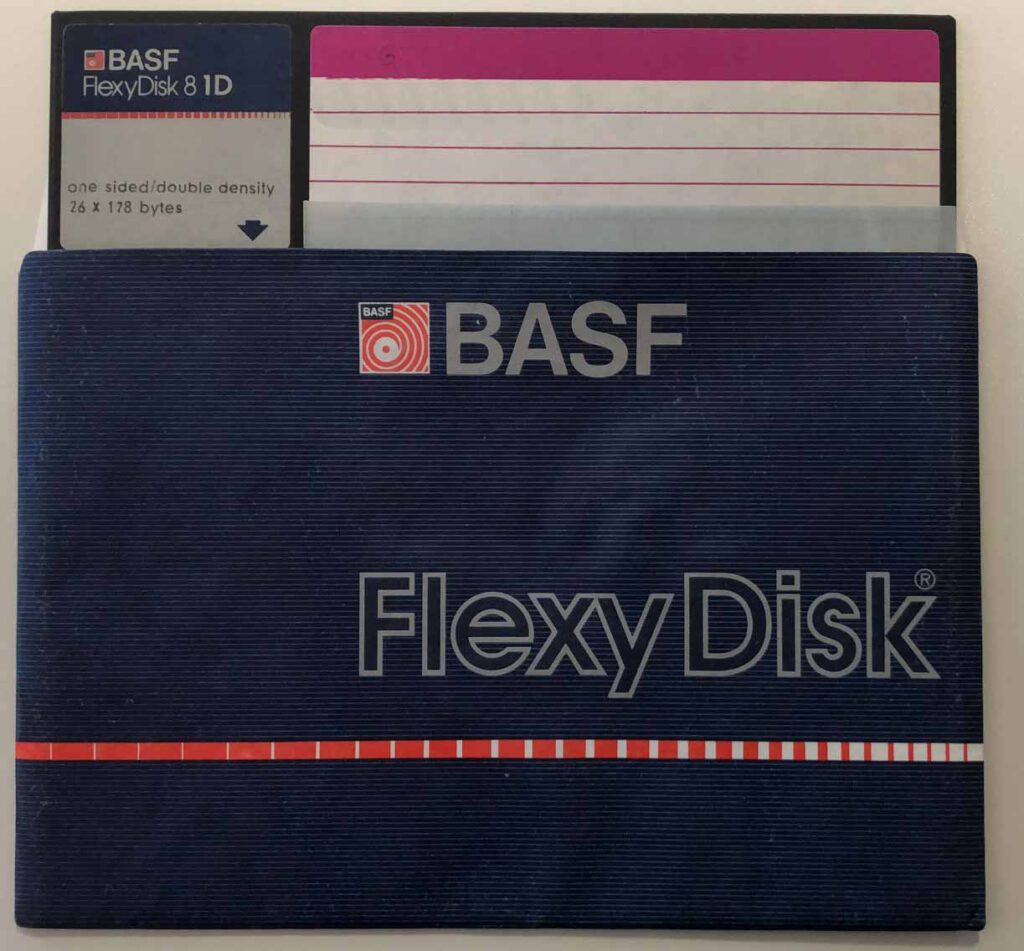

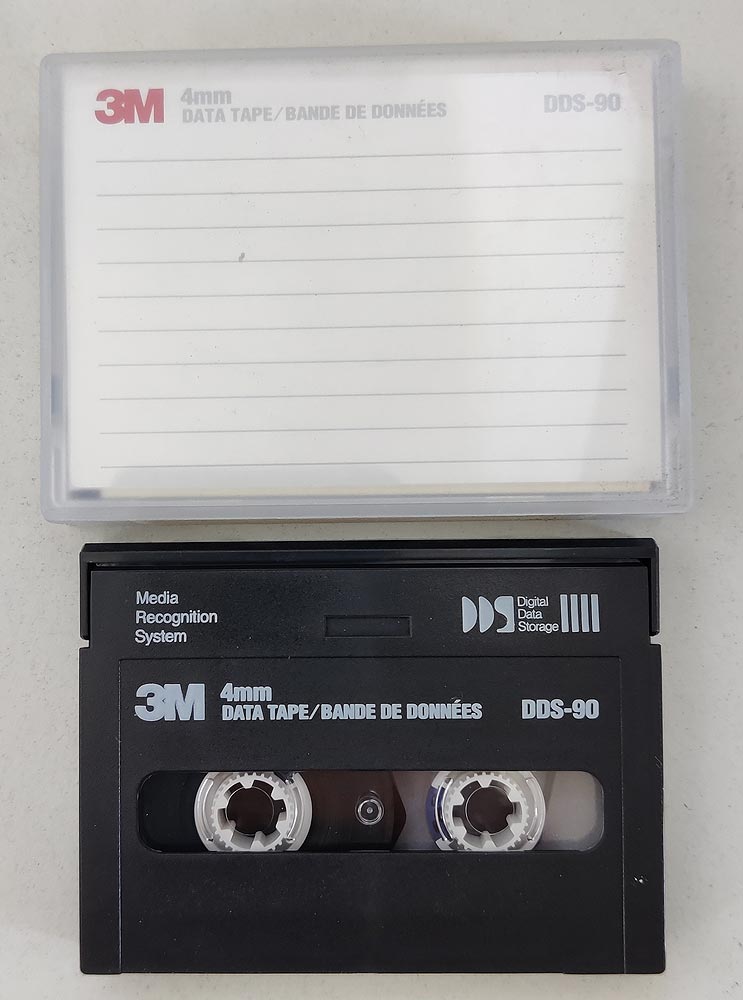

Diverse Hubs, Switche, Konsolumschalter, LAT-Terminalserver, Bandspeicher.

Ziel des neuen Designs:

Schnellere Hardware mit mehr Kernen und höherer Rechenleistung

Mehr Hauptspeicher

Mehr Plattenplatz

Mehr Schnittstellen für eine bessere Verteilung und Abschottung der Umgebung

Keine Wärmelast und der Verzicht auf die Klimatisierung

Deutlich niedrigerer Stomverbrauch

Problemlose Übernahme der vorhandenen Server auf die neue Umgebung

Konsequenter Einsatz von Open Source

Kostengünstige Lösung

Das Ergebnis:

3 x Minisform MS-A2 Server mit je

96GB Haupspeicher

12TB Plattenplatz (NVME), ausbaubar auf 96TB

2x 2,5 GB Ethernet

2x 10GB SPF+

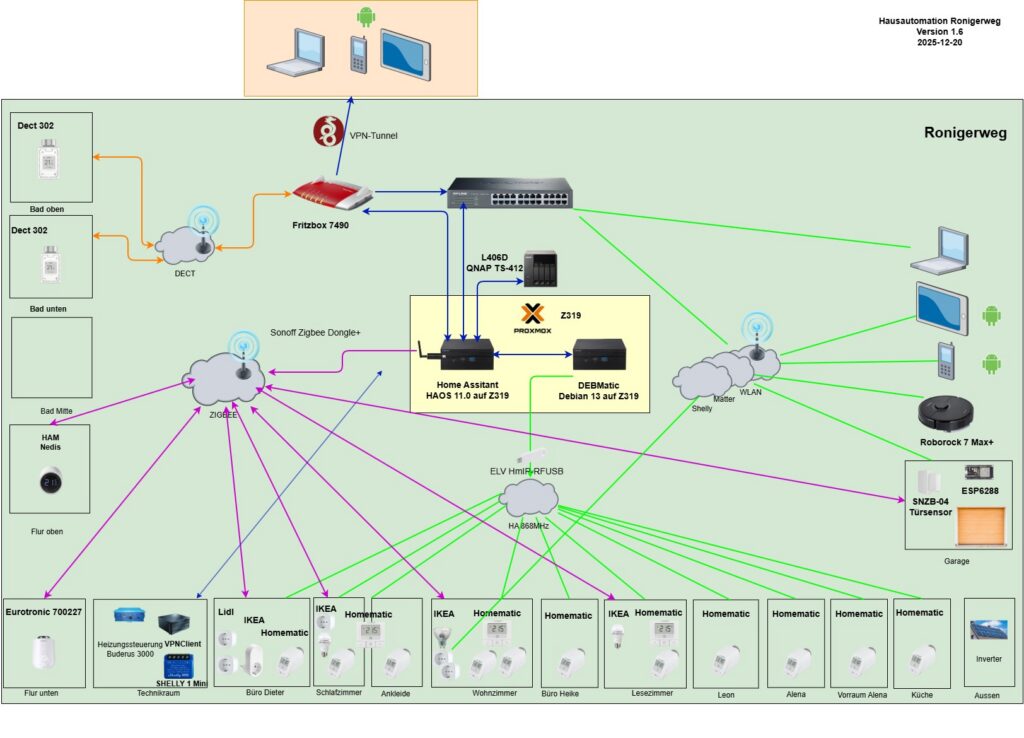

ProxMox als Virtualisierungsplattform.

Dazu ein MiniPC als Konsole

Konsolumschalter, um alle Systeme über eine Tastatur und einen Bildschirm betreiben zu können.

Als Ergänzung zur vorhandenen Netzwerkinfrastruktur eine Switch, der sowohl 10GB SPF als auch 2,5GB Ethernet bereitstellt.

Diese Umgebung erfüllt alle oben genannten Kriterien. Während bei der Altumgebung zwei USV mit voller Auslastung Sicherheit gegen Probleme im Stromnetz gewährleisteten, genügt nun eine kleine, die am unterer Rand ihrer Kapazität arbeitet. Alleine die gesparten Energiekosten kompensieren die Kosten für die neue Hardware innerhalb eines Jahres.

Die Migration von ESX nach Proxmox war sehr einfach und ohne Probleme.

Seit Inbetriebnahme der neuen Umgebung liegt die Temperatur im Rechnerraum immer auf der Höhe der Umgebungstemperaturen, eine Klimatisierung wird nicht mehr benötigt.

Zudem hat sich der Platzbedarf deutlich reduziert, jetzt genügem 10 Höheneinheiten statt zwei kompletter Racks, was Freiheiten bei der Platzierung des Gesamtsystems gibt.

Die Alpha-Systeme habe ich durch ein APX-Box-Virtualiserung unter Debian ersetzt, alles läuft schneller und die Abhängigkeit von alter proprietäter Hardware ist Geschichte.

Auch alle weiteren Services (Webhostung, Mailserver, DNS, Cloud, Entwicklungsumbgebung, NAS) laufen auf aktuellen Debianservern. zudem habe ich einen alten MacMini mit uraltem Betriebssystem durch eine Virtualisierung auf aktuellem Softwarestand ersetzt.

Die Hardware hat sich bisher bewährt, es gab über die Monate seit dem Umstieg keinerlei Ausfälle.